Curso de SQL y PostgreSQL

Aprende a consultar bases de datos desde cero. Un curso practico y progresivo que te llevara desde tu primera query SELECT hasta optimizar consultas con indices y EXPLAIN.

Enfocado en pensar en SQL y en el rendimiento de tus queries. No necesitas experiencia previa con bases de datos.

El timer Pomodoro te ayuda a estudiar en bloques cortos de concentracion (25 min) con descansos. Esta demostrado que mejora el aprendizaje y reduce la fatiga mental.

Parte de Hazla con Datos

Este curso es un recurso complementario de Hazla con Datos, una comunidad enfocada en programacion y ciencia de datos en salud. Encuentra mas cursos, recursos y herramientas para tu camino profesional.

Visitar hazlacondatos.com →Introduccion a SQL y PostgreSQL

¿Que es una base de datos?

Imagina que tienes un negocio y llevas el registro de tus clientes en una libreta. Al principio funciona bien, pero cuando tienes 500 clientes y necesitas encontrar a todos los de Santiago que compraron el mes pasado… la libreta se queda corta.

Una base de datos es exactamente eso: un sistema organizado para almacenar, buscar y manipular informacion de forma eficiente. En lugar de una libreta, tienes un software optimizado que puede buscar entre millones de registros en milisegundos.

Las bases de datos relacionales (las que vamos a usar en este curso) organizan la informacion en tablas con filas y columnas, como una hoja de calculo pero con superpoderes:

- Pueden manejar millones de registros sin perder velocidad

- Garantizan que los datos sean consistentes

- Permiten relacionar datos entre distintas tablas

- Multiples usuarios pueden acceder a la vez sin problemas

¿Que es SQL?

SQL (Structured Query Language) es el lenguaje que usamos para comunicarnos con bases de datos relacionales. Nacio en los anos 70 en IBM y hoy en dia es uno de los lenguajes mas usados del mundo.

SQL se pronuncia...

Hay dos formas aceptadas: “ese-cu-ele” (letra por letra) o “sequel” (como en ingles). Ambas estan bien. En este curso usaremos “SQL” como sigla.

El paradigma declarativo

Antes de ver codigo, necesitas entender algo fundamental: SQL pertenece al paradigma declarativo. Esto cambia completamente la forma en que piensas al programar.

En programacion existen dos grandes familias de paradigmas:

-

Imperativo: tu escribes los pasos exactos que la computadora debe seguir. Le dices como hacer algo. Es lo que hacen lenguajes como Python, JavaScript, Java o C. Tu controlas el flujo: bucles, condicionales, variables que van cambiando paso a paso.

-

Declarativo: tu describes el resultado que quieres y el sistema decide como obtenerlo. No te preocupas por el orden de ejecucion, ni por los algoritmos internos, ni por como se recorren los datos. Solo defines que necesitas.

SQL es declarativo. Esto significa que cuando escribes una consulta, no estas dando instrucciones paso a paso. Estas haciendo una declaracion de lo que quieres obtener:

-- Tu describes lo que quieres:SELECT nombre, emailFROM clientesWHERE ciudad = 'Santiago';Con esa consulta le estas diciendo: “dame el nombre y email de los clientes que viven en Santiago”. No le dices como buscar, en que orden recorrer los datos ni que algoritmo usar. La base de datos se encarga de eso.

¿Por que esto importa? Porque libera al programador de pensar en la implementacion. PostgreSQL tiene un planificador de consultas (query planner) que analiza tu consulta y decide la estrategia mas eficiente para ejecutarla. Puede usar indices, paralelismo, distintos algoritmos de ordenamiento… todo sin que tu lo pidas. Tu trabajo es describir bien lo que necesitas; el trabajo del motor es encontrar la mejor forma de darlo.

Otros lenguajes declarativos

SQL no es el unico lenguaje declarativo. HTML describe la estructura de una pagina (no como renderizarla). CSS describe estilos (no como pintarlos). Las expresiones regulares describen patrones (no como buscarlos). Si ya usaste alguno de estos, ya tienes experiencia con el paradigma declarativo.

¿Que es PostgreSQL?

PostgreSQL (o simplemente “Postgres”) es un sistema de gestion de bases de datos relacional, gratuito y de codigo abierto. Es uno de los mas potentes y populares del mundo, usado por empresas como Apple, Instagram, Spotify y Netflix.

¿Por que aprender PostgreSQL?

- Es gratis y open source: sin licencias ni costos ocultos

- Es potente: soporta consultas complejas, datos JSON, busqueda de texto completo y mucho mas

- Es el estandar de la industria: si aprendes Postgres, puedes trabajar con casi cualquier base de datos relacional

- Gran comunidad: documentacion excelente y millones de desarrolladores que lo usan

- Cumple con el estandar SQL: lo que aprendas aqui aplica a MySQL, SQL Server, SQLite y otros

¿Y otras bases de datos?

El 90% de lo que vas a aprender en este curso funciona igual en MySQL, SQL Server, SQLite y otros motores SQL. PostgreSQL tiene algunas funciones extra, pero las bases son las mismas.

Declarativo vs imperativo: un ejemplo concreto

Para que la diferencia quede clara, veamos el mismo problema resuelto en ambos paradigmas.

En Python (imperativo), para obtener los clientes de Santiago escribirias algo asi:

# Enfoque imperativo (paso a paso)clientes_santiago = []for cliente in todos_los_clientes: if cliente.ciudad == "Santiago": clientes_santiago.append(cliente.nombre)En SQL, simplemente describes lo que quieres:

-- Enfoque declarativo (describes el resultado)SELECT nombreFROM clientesWHERE ciudad = 'Santiago';No le dices a la base de datos “recorre todos los clientes uno por uno y fijate si la ciudad es Santiago”. Le dices “quiero los nombres donde la ciudad sea Santiago” y ella decide la forma mas eficiente de hacerlo.

Por que importa esta distincion

Si vienes de Python, R, JavaScript o cualquier lenguaje de proposito general, tu cerebro esta entrenado para pensar en pasos: “primero recorro, luego filtro, luego guardo”. Esa logica no sirve en SQL. Intentar escribir SQL como si fuera un bucle es una de las principales fuentes de frustacion (y de consultas lentas) en principiantes. La forma de abordar el problema es fundamentalmente distinta: en SQL no controlas el como, solo defines el que.

La buena noticia es que no estas solo en esta transicion. Existen frameworks en lenguajes imperativos que adoptan un estilo declarativo muy similar al de SQL, lo que facilita mucho el salto mental:

- Python:

pandaspermite encadenar operaciones como.query(),.groupby(),.merge()que se parecen mucho aWHERE,GROUP BYyJOIN. SQLAlchemy va un paso mas alla y te deja construir consultas SQL con sintaxis Python. - R:

dplyr(parte del tidyverse) fue disenado explicitamente para imitar la logica de SQL. Funciones comofilter(),select(),group_by()ysummarise()son practicamente traducciones directas de clausulas SQL.

Si ya usas alguno de estos, vas a notar que aprender SQL se siente familiar. Y si aun no los conoces, aprender SQL primero te va a hacer mucho mas productivo cuando los uses despues.

Todo tiene un costo

Cada operacion SQL tiene un costo computacional. Cuando escribes SELECT * FROM clientes, la base de datos tiene que leer todas las columnas de cada fila, transferirlas por red y formatearlas para mostrartelas — aunque solo necesites el nombre y el email. Por eso, en aplicaciones reales siempre se especifican las columnas exactas que se necesitan (SELECT nombre, email FROM clientes). El SELECT * es perfecto para explorar datos o dar tus primeros pasos con una tabla, pero en produccion es un desperdicio de recursos. A lo largo de este curso vamos a ir aprendiendo como escribir consultas que hagan solo el trabajo necesario.

Ejercicios

Estos ejercicios no requieren tener PostgreSQL instalado todavia. Son para reforzar los conceptos de este modulo. En el Modulo 2 vas a preparar tu entorno y cargar la base de datos tienda que usaremos en todo el curso.

La base de datos tienda

A lo largo del curso trabajaremos con una base de datos llamada tienda que tiene 5 tablas: productos (id, nombre, precio, categoria, stock, fecha_creacion), clientes (id, nombre, email, ciudad, fecha_registro), pedidos (id, cliente_id, fecha, total, estado), detalle_pedidos (id, pedido_id, producto_id, cantidad, precio_unitario) y empleados (id, nombre, departamento, salario, fecha_contratacion, jefe_id).

Ejercicio 1: Imagina que tienes la tabla productos con las columnas: id, nombre, precio, categoria, stock y fecha_creacion. Escribe en palabras que le pedirias a SQL para obtener: (a) todos los nombres de productos, y (b) los productos con precio mayor a 100.

Ver solucion

(a) “Dame la columna nombre de la tabla productos” → SELECT nombre FROM productos;

(b) “Dame todos los productos donde el precio sea mayor a 100” → SELECT * FROM productos WHERE precio > 100;

Lo importante es que pienses en que quieres, no en como obtenerlo. SQL es declarativo: describes el resultado, no los pasos.

Ejercicio 2: Identifica cual de estos enfoques es declarativo y cual es imperativo:

- Opcion A: “Recorre cada fila de la tabla clientes. Si la ciudad es ‘Santiago’, guarda el nombre en una lista.”

- Opcion B: “Dame los nombres de la tabla clientes donde la ciudad sea Santiago.”

Ver solucion

- Opcion A es imperativa: describes los pasos (recorrer, verificar, guardar). Es como lo harias en Python o JavaScript con un bucle.

- Opcion B es declarativa: describes el resultado que quieres. Es como lo haces en SQL:

SELECT nombre FROM clientes WHERE ciudad = 'Santiago';En SQL siempre usamos el enfoque B. Le decimos a la base de datos que queremos y ella decide como obtenerlo.

Ejercicio 3: Sin ejecutar nada, lee esta consulta SQL y describe en palabras que resultado esperas:

SELECT nombre, precioFROM productosWHERE categoria = 'Electronica'ORDER BY precio DESC;Ver solucion

“Dame el nombre y precio de todos los productos que son de la categoria Electronica, ordenados de mayor a menor precio.”

El resultado seria una lista de productos electronicos mostrando solo dos columnas (nombre y precio), con el mas caro arriba y el mas barato abajo. Desglose:

SELECT nombre, precio→ solo esas dos columnasFROM productos→ de la tabla productosWHERE categoria = 'Electronica'→ solo los de esa categoriaORDER BY precio DESC→ ordenados de mayor a menor

Ejercicio 4: ¿Por que SELECT * FROM productos es menos eficiente que SELECT nombre, precio FROM productos? ¿En que situacion usarias SELECT *?

Ver solucion

SELECT * pide todas las columnas de la tabla (id, nombre, precio, categoria, stock, fecha_creacion), aunque solo necesites dos. Esto significa:

- Mas datos leidos del disco

- Mas datos transferidos por la red

- Mas memoria usada para procesar los resultados

SELECT nombre, precio solo pide las columnas que necesitas, lo cual es mas rapido y consume menos recursos.

¿Cuando usar SELECT *? Es util para explorar una tabla que no conoces, para ver su estructura y datos. Pero en consultas de produccion (aplicaciones, reportes automaticos), siempre es mejor especificar las columnas exactas.

¿Que sigue?

En el proximo modulo vas a preparar tu entorno de trabajo: instalar PostgreSQL, configurar DBeaver y cargar la base de datos de practica que usaremos a lo largo de todo el curso.

Preparando el entorno

En este modulo vas a preparar tu entorno de trabajo. Al final tendras PostgreSQL funcionando, un cliente SQL listo para usar y la base de datos de practica cargada con datos. Todo lo que necesitas para seguir el resto del curso.

Que necesitas

Dos cosas:

- Un servidor PostgreSQL — donde viven las bases de datos

- Un cliente SQL — la herramienta donde escribes y ejecutas consultas

Vamos a instalar ambos paso a paso.

Quieres probar antes de instalar?

Existen playgrounds online donde puedes ejecutar SQL directamente en el navegador sin instalar nada. Mira la seccion “Playgrounds online” mas abajo. Son utiles como primer acercamiento, pero para seguir todo el curso necesitaras un entorno local.

Paso 1: Instalar PostgreSQL

Descarga PostgreSQL desde postgresql.org/download y sigue el instalador para tu sistema operativo.

Durante la instalacion:

- Te pedira crear una contraseña para el usuario

postgres. Anotala en algun lugar seguro, la necesitaras para conectarte. - Deja el puerto en

5432(es el puerto por defecto). - No necesitas instalar componentes adicionales como Stack Builder.

Verificar la instalacion

En Windows, busca “SQL Shell (psql)” en el menu de inicio. En macOS/Linux, abre una terminal y escribe psql --version. Si ves un numero de version, la instalacion fue exitosa.

Paso 2: Instalar DBeaver Community

DBeaver es un cliente SQL gratuito y visual. Es el que vamos a usar a lo largo del curso porque tiene una interfaz amigable, soporta multiples bases de datos y funciona en Windows, macOS y Linux.

Descargalo desde dbeaver.io/download e instalalo normalmente.

Otras opciones de cliente SQL

Si ya tienes experiencia, puedes usar pgAdmin (viene con PostgreSQL), psql (terminal), o cualquier otro cliente SQL. Todo lo que veremos funciona en cualquier herramienta que pueda conectarse a PostgreSQL.

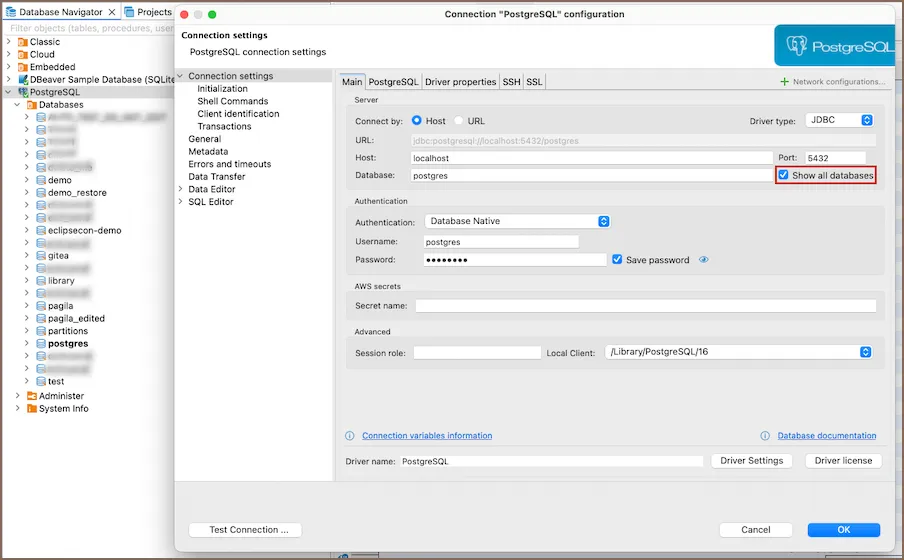

Paso 3: Conectarte a PostgreSQL desde DBeaver

Abre DBeaver y sigue estos pasos para crear tu primera conexion:

- Ve al menu Database → New Database Connection (o usa el atajo

Ctrl+Shift+N) - Selecciona PostgreSQL en la lista y click en Next

- Completa los datos de conexion:

- Host:

localhost - Port:

5432 - Database:

postgres(la base de datos por defecto) - Username:

postgres - Password: la contraseña que creaste durante la instalacion

- Host:

- Ve a la pestaña PostgreSQL (en la parte superior del dialogo) y marca la opcion Show all databases

- Click en Test Connection para verificar que funciona

- Si el test es exitoso, click en Finish

Por que activar Show all databases?

PostgreSQL en DBeaver solo muestra por defecto la base de datos a la que te conectaste (postgres). Si no activas Show all databases, cuando crees la base de datos tienda mas adelante, no la veras en el panel de navegacion. Esta opcion solo esta disponible cuando usas el tipo de conexion Host (que es el que viene por defecto).

Si la conexion falla

Verifica que: (1) PostgreSQL esta corriendo como servicio, (2) el puerto es 5432, (3) la contraseña es correcta. En Windows, busca “Servicios” y verifica que “postgresql” este en estado “Ejecutando”.

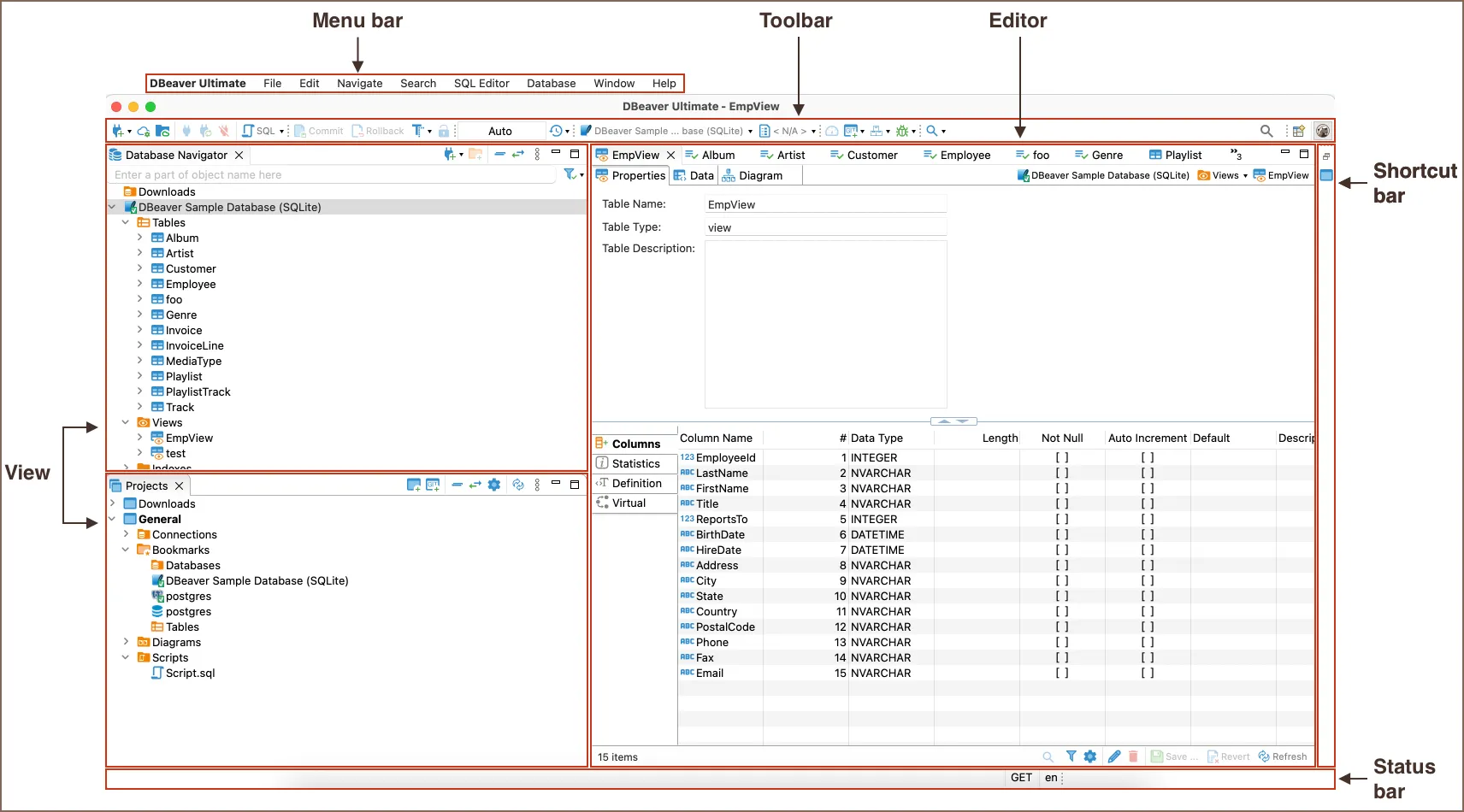

Paso 4: Conociendo DBeaver

Antes de crear la base de datos del curso, vamos a conocer las partes principales de DBeaver. Asi vas a saber exactamente donde escribir SQL, como ejecutarlo y donde ver los resultados.

La ventana principal

Cuando abras DBeaver, vas a ver una ventana dividida en varias areas. Cada una tiene un proposito especifico:

- Menu bar (arriba): los menus File, Edit, SQL Editor, Database, Window, etc. Desde aca accedes a todas las funciones de DBeaver.

- Toolbar (debajo del menu): botones de acceso rapido para las acciones mas comunes, como crear una conexion o abrir un editor SQL.

- Views (paneles laterales): ventanas como el Database Navigator (a la izquierda) que muestran informacion de navegacion. Es como el “explorador de archivos” pero para bases de datos.

- Editor (area central): donde se abren los editores SQL, las propiedades de tablas, los datos, los diagramas, etc. Es el area donde vas a trabajar la mayor parte del tiempo.

- Status bar (abajo): muestra informacion de estado de la conexion actual.

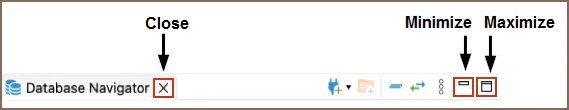

Cada panel se puede cerrar, minimizar o maximizar usando los botones en su barra de titulo:

Se te cerro un panel?

Si cierras el Database Navigator por accidente, puedes reabrirlo desde el menu Window → Database Navigator.

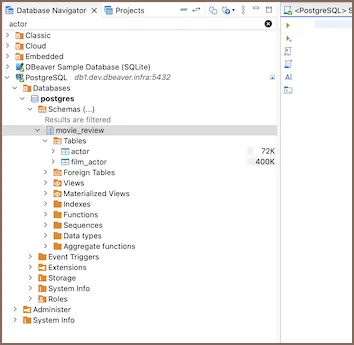

Database Navigator (panel izquierdo)

El Database Navigator es el panel mas importante. Muestra un arbol jerarquico con toda la estructura de tus bases de datos, similar a un explorador de carpetas:

Conexion (PostgreSQL) └── Databases └── tienda └── Schemas └── public ├── Tables │ ├── productos │ ├── clientes │ └── ... ├── Views └── FunctionsUn Schema es como una carpeta que organiza las tablas dentro de una base de datos. PostgreSQL crea automaticamente un schema llamado public donde van tus tablas por defecto. No necesitas crear schemas adicionales para este curso.

Para navegar, haz click en la flecha (o triangulo) junto a cada elemento para expandirlo y ver su contenido. Desde aca puedes explorar tablas, columnas y relaciones sin escribir una sola linea de SQL.

Acciones utiles del Navigator:

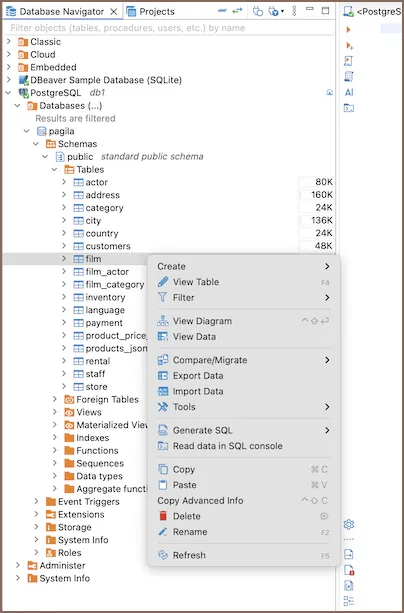

- Click derecho en una tabla → aparece un menu con opciones como View Table (ver datos), Generate SQL (generar consultas automaticamente), Export Data (exportar datos), etc.

- Doble click en una tabla → abre sus propiedades con pestañas: Properties, Data (datos), Diagram (diagrama ER)

- Arrastrar una tabla al editor SQL → inserta el nombre de la tabla en tu consulta

Simple vs Advanced view

Haz click derecho en tu conexion → Connection view para cambiar entre Simple (muestra solo lo esencial: tablas, vistas) y Advanced (muestra todo, incluyendo objetos avanzados del sistema). Para este curso, Simple es suficiente.

Filtrar objetos: usa la barra de busqueda en la parte superior del Navigator para encontrar tablas u objetos por nombre. Es muy util cuando una base de datos tiene muchas tablas.

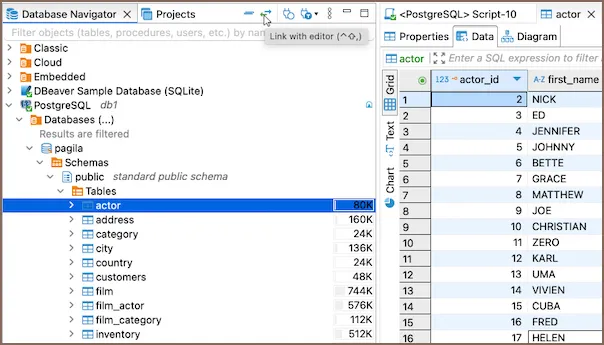

Link with Editor: el boton Link with Editor en la toolbar del Navigator sincroniza la seleccion del arbol con el editor activo. Si lo activas y abres una tabla, el Navigator automaticamente la resalta en el arbol.

SQL Editor: donde escribes y ejecutas SQL

El SQL Editor es el area donde vas a escribir tus consultas SQL durante todo el curso. Piensa en el como un editor de texto, pero conectado directamente a tu base de datos.

Como abrirlo:

- Ve al menu SQL Editor → New SQL Editor

- O usa el atajo de teclado:

Ctrl+](Windows/Linux) o⌃](macOS)

Una vez abierto, simplemente escribe tu SQL en el area de texto. Los resultados apareceran en un panel debajo del editor.

Como ejecutar SQL:

Hay tres formas de ejecutar codigo SQL. Es importante conocer la diferencia:

| Que quieres hacer | Que hacer | Windows/Linux | macOS |

|---|---|---|---|

| Ejecutar una sentencia (donde esta tu cursor) | Pon el cursor en la linea y presiona el atajo | Ctrl+Enter | ⌘+Enter |

| Ejecutar todo el script completo | Presiona el atajo directamente | Alt+X | ⌥+X |

| Ejecutar solo una parte | Selecciona el texto con el mouse y presiona el atajo | Seleccionar + Ctrl+Enter | Seleccionar + ⌘+Enter |

Diferencia importante

Ctrl+Enter no ejecuta todo el contenido del editor. Solo ejecuta la sentencia donde esta tu cursor (cada sentencia termina con ;). Si tienes varias sentencias y quieres ejecutarlas todas de una vez, usa Alt+X. Esta diferencia es muy importante y la vas a usar constantemente en el curso.

Otras cosas utiles del editor:

- Puedes tener multiples pestañas de SQL abiertas al mismo tiempo (como pestañas de un navegador).

- Asegurate siempre de que el editor esta conectado a la base de datos correcta — verifica el selector de conexion/base de datos en la barra superior del editor. Si estas conectado a

postgrespero quieres trabajar contienda, cambialo ahi.

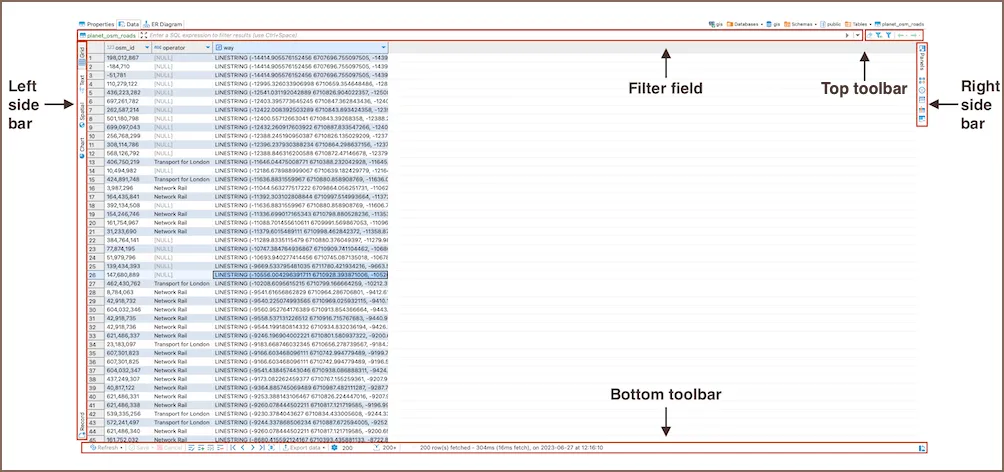

Data Editor: ver y editar datos de una tabla

Cuando haces doble click en una tabla en el Navigator y seleccionas la pestaña Data, se abre el Data Editor. Es una grilla interactiva (como una planilla de calculo) que muestra los datos de la tabla.

Que puedes hacer:

- Ver datos en formato de tabla (Grid), texto plano (Text) o registro individual (Record)

- Filtrar usando la barra de filtro en la parte superior — escribe condiciones SQL como

precio > 100 - Ordenar haciendo click en el encabezado de una columna

- Editar datos directamente: haz click en una celda, modifica el valor, y luego click en el boton Save de la toolbar inferior para guardar los cambios

- Agregar o eliminar filas usando los botones de la toolbar inferior

Cuidado al editar datos

Los cambios en el Data Editor se aplican directamente a la base de datos al hacer click en Save. Para tablas de practica esto esta bien, pero ten cuidado en entornos reales.

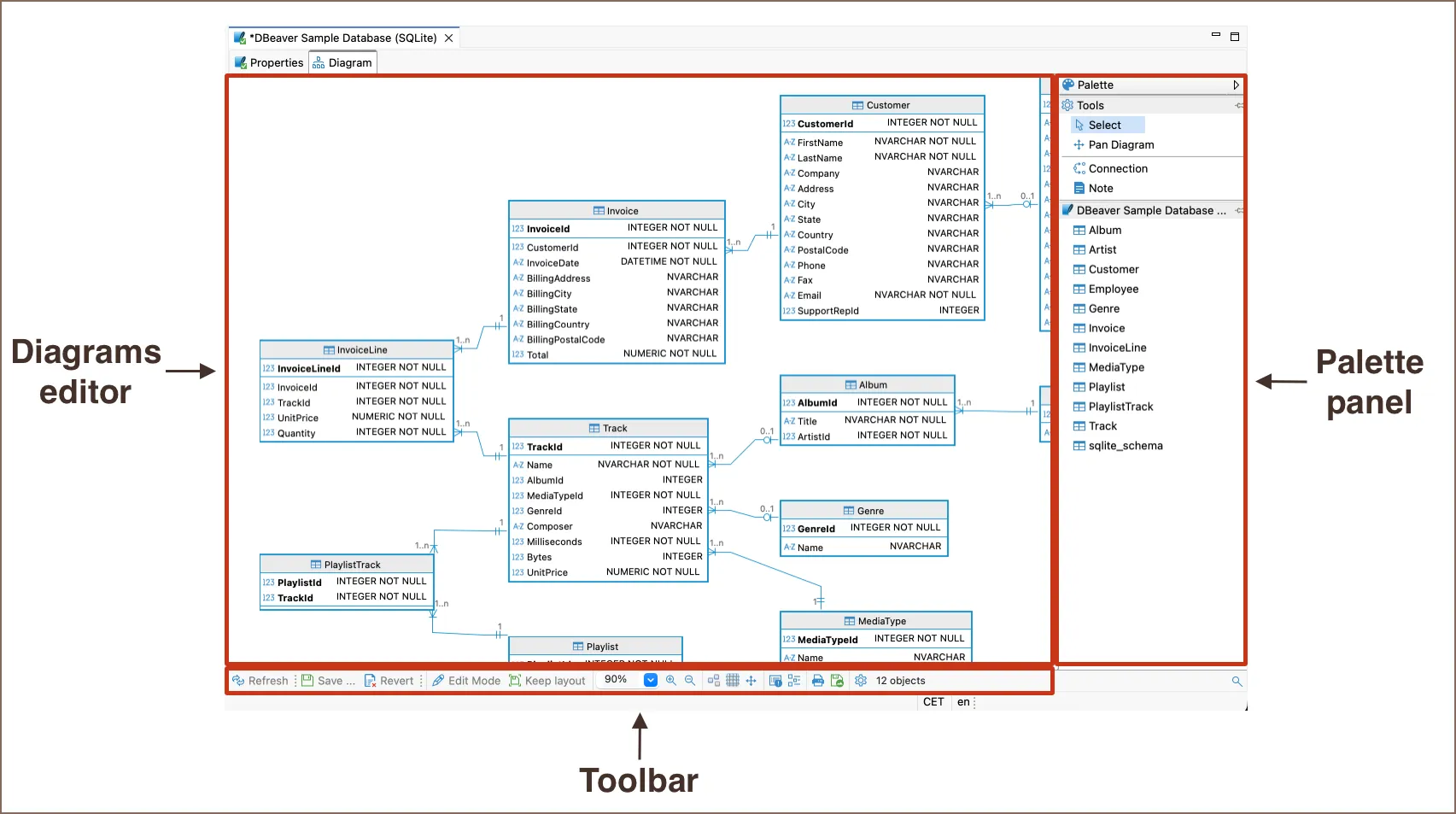

Diagramas ER: ver las relaciones entre tablas

DBeaver puede generar diagramas de entidad-relacion automaticamente, lo que te permite ver graficamente como se relacionan las tablas. Esto es muy util para entender la estructura de una base de datos.

Como verlos:

- En el Navigator, haz doble click en el schema public (o en el nodo Tables) → se abre una pestaña con el diagrama completo

- Tambien puedes ver el diagrama de una tabla individual: doble click en la tabla → pestaña Diagram

El diagrama muestra:

- Las tablas como cajas con sus columnas y tipos de datos

- Las relaciones como lineas entre tablas. Estas lineas representan las conexiones entre tablas (por ejemplo, que un pedido pertenece a un cliente)

- La direccion de las relaciones (uno-a-muchos, etc.)

Acciones utiles:

- Auto-arrange: reorganiza las tablas automaticamente para mejor legibilidad

- Zoom: acerca o aleja el diagrama

- Cambiar notacion: click derecho → Notation para cambiar el estilo visual de las relaciones

- Exportar como imagen: click derecho → Save as Image para guardar el diagrama como PNG, SVG u otro formato

Resumen de atajos de DBeaver

Estos son los atajos que mas vas a usar en el curso. No necesitas memorizarlos ahora, pero tenlos a mano:

| Accion | Windows/Linux | macOS |

|---|---|---|

| Nueva conexion | Ctrl+Shift+N | Ctrl+Shift+N |

| Nuevo SQL Editor | Ctrl+] | ⌃] |

| Ejecutar sentencia | Ctrl+Enter | ⌘+Enter |

| Ejecutar script completo | Alt+X | ⌥+X |

Para mas detalles sobre todas las funcionalidades de DBeaver, consulta la documentacion oficial.

Paso 5: Crear la base de datos de practica

Ahora que ya conoces DBeaver, vamos a crear la base de datos que usaremos durante todo el curso. Es la base de datos de una tienda ficticia con 5 tablas que simulan un sistema real de pedidos:

- productos: los articulos que vende la tienda

- clientes: las personas que compran

- pedidos: cada compra realizada

- detalle_pedidos: los productos dentro de cada pedido

- empleados: el equipo de la tienda (con jerarquia de jefes)

Diagrama de relaciones

Las tablas no estan aisladas: se conectan entre si. Por ejemplo, un pedido necesita saber a que cliente pertenece. Esa conexion se llama relacion y es fundamental en bases de datos.

clientes ──< pedidos ──< detalle_pedidos >── productosempleados (jefe_id -> empleados.id)El simbolo ──< significa “uno a muchos”: un cliente puede tener muchos pedidos, pero cada pedido pertenece a un solo cliente. Cada pedido puede tener muchos detalles, y cada detalle referencia a un producto. Los empleados pueden tener un jefe que tambien es empleado.

No te preocupes si esto no queda claro ahora. Lo vas a entender completamente cuando lleguemos al modulo de JOINs (modulo 7).

Paso 5.1: Crear la base de datos tienda

- En el Database Navigator (panel izquierdo), expande tu conexion haciendo click en la flecha junto a ella

- Haz click derecho sobre el nodo Databases → Create New Database

- Escribe

tiendacomo nombre y click en OK - Doble click en

tiendapara conectarte a ella

Paso 5.2: Crear las tablas

- Abre un nuevo editor SQL: en el menu superior haz click en SQL Editor y luego en New SQL Editor (o usa el atajo

Ctrl+]) - Verifica que en la barra superior del editor aparezca tienda como base de datos activa. Si aparece otra (como

postgres), haz click en el selector y cambiala atienda. - Copia todo el codigo SQL de abajo (selecciona todo con

Ctrl+A, luegoCtrl+C) y pegalo en el editor (Ctrl+V). En macOS usa⌘en lugar deCtrl.

No te preocupes por entender este SQL todavia

El codigo de abajo crea las tablas de la base de datos. Usa palabras como SERIAL, VARCHAR o REFERENCES que quizas no conoces. Eso es completamente normal. En los siguientes modulos vas a aprender que significa cada una. Por ahora, solo necesitas copiarlo, pegarlo y ejecutarlo.

CREATE TABLE productos ( id SERIAL PRIMARY KEY, nombre VARCHAR(100) NOT NULL, precio DECIMAL(10,2) NOT NULL, categoria VARCHAR(50), stock INTEGER DEFAULT 0, fecha_creacion DATE DEFAULT CURRENT_DATE);

CREATE TABLE clientes ( id SERIAL PRIMARY KEY, nombre VARCHAR(100) NOT NULL, email VARCHAR(100) UNIQUE, ciudad VARCHAR(50), fecha_registro DATE DEFAULT CURRENT_DATE);

CREATE TABLE pedidos ( id SERIAL PRIMARY KEY, cliente_id INTEGER REFERENCES clientes(id), fecha DATE DEFAULT CURRENT_DATE, total DECIMAL(10,2), estado VARCHAR(20) DEFAULT 'pendiente');

CREATE TABLE detalle_pedidos ( id SERIAL PRIMARY KEY, pedido_id INTEGER REFERENCES pedidos(id), producto_id INTEGER REFERENCES productos(id), cantidad INTEGER NOT NULL, precio_unitario DECIMAL(10,2) NOT NULL);

CREATE TABLE empleados ( id SERIAL PRIMARY KEY, nombre VARCHAR(100) NOT NULL, departamento VARCHAR(50), salario DECIMAL(10,2), fecha_contratacion DATE DEFAULT CURRENT_DATE, jefe_id INTEGER REFERENCES empleados(id));- Ejecuta todo el script presionando

Alt+X(macOS:⌥+X). Esto crea las 5 tablas de una sola vez.

Como saber si funciono?

Si todo salio bien, vas a ver mensajes de confirmacion en el panel de resultados (abajo). Luego, en el Database Navigator, expande tienda → Schemas → public → Tables y deberias ver las 5 tablas creadas. Si no aparecen, haz click derecho en Tables → Refresh.

Paso 5.3: Insertar los datos de prueba

Las tablas estan creadas pero vacias. Ahora vamos a llenarlas con datos de ejemplo para poder practicar durante todo el curso.

- Abre una nueva pestaña de SQL Editor (

Ctrl+]). Tambien puedes usar la misma pestaña si borras el contenido anterior. - Copia todo el codigo SQL de abajo (

Ctrl+Apara seleccionar,Ctrl+Cpara copiar) y pegalo en el editor (Ctrl+V):

INSERT INTO productos (nombre, precio, categoria, stock) VALUES('Laptop Pro 15', 1299.99, 'Electronica', 45),('Mouse Inalambrico', 29.99, 'Electronica', 150),('Teclado Mecanico', 89.99, 'Electronica', 80),('Monitor 27 pulgadas', 449.99, 'Electronica', 30),('Auriculares Bluetooth', 59.99, 'Electronica', 200),('Escritorio Ajustable', 399.99, 'Muebles', 25),('Silla Ergonomica', 299.99, 'Muebles', 40),('Lampara LED', 34.99, 'Muebles', 100),('Mochila para Laptop', 49.99, 'Accesorios', 120),('Hub USB-C', 39.99, 'Accesorios', 90),('Webcam HD', 79.99, 'Electronica', 60),('Cable HDMI 2m', 12.99, 'Accesorios', 300),('Soporte Monitor', 44.99, 'Muebles', 55),('Mousepad XL', 19.99, 'Accesorios', 180),('Cargador Rapido', 24.99, 'Accesorios', 250);

INSERT INTO clientes (nombre, email, ciudad) VALUES('Maria Garcia', 'maria@email.com', 'Santiago'),('Carlos Lopez', 'carlos@email.com', 'Valparaiso'),('Ana Martinez', 'ana@email.com', 'Santiago'),('Pedro Sanchez', 'pedro@email.com', 'Concepcion'),('Laura Torres', 'laura@email.com', 'Santiago'),('Diego Rivera', 'diego@email.com', 'Valparaiso'),('Carmen Ruiz', 'carmen@email.com', 'Temuco'),('Roberto Diaz', 'roberto@email.com', 'Santiago'),('Isabel Moreno', 'isabel@email.com', 'Antofagasta'),('Andres Vargas', 'andres@email.com', 'Concepcion');

INSERT INTO pedidos (cliente_id, fecha, total, estado) VALUES(1, '2024-01-15', 1389.98, 'completado'),(2, '2024-01-20', 89.99, 'completado'),(3, '2024-02-01', 499.98, 'completado'),(1, '2024-02-14', 59.99, 'completado'),(4, '2024-02-28', 1749.98, 'enviado'),(5, '2024-03-05', 149.97, 'completado'),(6, '2024-03-10', 299.99, 'pendiente'),(3, '2024-03-15', 839.98, 'enviado'),(7, '2024-03-20', 34.99, 'completado'),(8, '2024-03-25', 479.98, 'pendiente'),(2, '2024-04-01', 129.98, 'completado'),(9, '2024-04-05', 1299.99, 'enviado'),(10, '2024-04-10', 69.98, 'pendiente'),(1, '2024-04-15', 449.99, 'completado'),(5, '2024-04-20', 89.99, 'completado');

INSERT INTO detalle_pedidos (pedido_id, producto_id, cantidad, precio_unitario) VALUES(1, 1, 1, 1299.99),(1, 2, 3, 29.99),(2, 3, 1, 89.99),(3, 7, 1, 299.99),(3, 8, 2, 34.99),(3, 14, 1, 19.99),(4, 5, 1, 59.99),(5, 1, 1, 1299.99),(5, 4, 1, 449.99),(6, 9, 3, 49.99),(7, 7, 1, 299.99),(8, 4, 1, 449.99),(8, 10, 2, 39.99),(8, 3, 1, 89.99),(9, 8, 1, 34.99),(10, 11, 1, 79.99),(10, 6, 1, 399.99),(11, 2, 1, 29.99),(11, 14, 5, 19.99),(12, 1, 1, 1299.99),(13, 12, 2, 12.99),(13, 15, 1, 24.99),(14, 4, 1, 449.99),(15, 3, 1, 89.99);

INSERT INTO empleados (nombre, departamento, salario, fecha_contratacion, jefe_id) VALUES('Sofia Mendez', 'Gerencia', 85000, '2020-01-15', NULL),('Juan Perez', 'Ventas', 45000, '2021-03-01', 1),('Valentina Castro', 'Ventas', 42000, '2021-06-15', 1),('Miguel Angel Torres', 'Tecnologia', 62000, '2020-08-01', 1),('Camila Rojas', 'Tecnologia', 55000, '2022-01-10', 4),('Alejandro Vega', 'Tecnologia', 58000, '2021-11-20', 4),('Fernanda Luna', 'Ventas', 40000, '2023-02-01', 2),('Ricardo Soto', 'Soporte', 38000, '2022-07-15', 4),('Patricia Herrera', 'Soporte', 36000, '2023-05-01', 8),('Daniela Flores', 'Ventas', 41000, '2023-08-10', 2);- Ejecuta todo con

Alt+X(macOS:⌥+X).

Atajo: usa el script del repositorio

Si clonaste el repositorio del curso, el script completo esta en db/init.sql. Puedes abrirlo directamente en DBeaver con File → Open File y ejecutarlo con Alt+X (macOS: ⌥+X). Es mas rapido que copiar y pegar.

Paso 5.4: Verificar que todo funciona

Vamos a confirmar que los datos se cargaron correctamente. En el mismo editor SQL (o en una nueva pestaña), copia y pega estas consultas:

SELECT COUNT(*) FROM productos; -- Deberia devolver: 15SELECT COUNT(*) FROM clientes; -- Deberia devolver: 10SELECT COUNT(*) FROM pedidos; -- Deberia devolver: 15SELECT COUNT(*) FROM detalle_pedidos; -- Deberia devolver: 24SELECT COUNT(*) FROM empleados; -- Deberia devolver: 10Para ejecutarlas, tienes dos opciones:

- Todas a la vez: presiona

Alt+Xpara ejecutar todo el script. Los resultados de cada consulta apareceran en pestañas separadas en el panel inferior. - Una por una: pon el cursor en la linea de la consulta que quieres ejecutar y presiona

Ctrl+Enter. Esto es util para ir verificando tabla por tabla.

Si todos los numeros coinciden, tu base de datos esta lista.

Verificacion visual

Tambien puedes verificar visualmente: en el Database Navigator, expande tienda → Schemas → public → Tables, haz doble click en cualquier tabla (por ejemplo, productos) y selecciona la pestaña Data. Deberias ver los datos en formato de grilla.

Playgrounds online: practica sin instalar nada

Si quieres un primer acercamiento a SQL antes de instalar software, existen playgrounds online donde puedes escribir y ejecutar consultas directamente en el navegador:

- aprendesql.dev/playground — Recomendado. Playground en español con soporte para PostgreSQL. Ideal para empezar a experimentar.

- sqlfiddle.com — Uno de los playgrounds mas conocidos. Soporta PostgreSQL y otros motores.

- db-fiddle.com — Similar a SQL Fiddle, con interfaz limpia y soporte para PostgreSQL.

Puedes copiar el SQL de creacion de tablas e insercion de datos de la seccion anterior, pegarlo en cualquiera de estos playgrounds y empezar a practicar de inmediato.

Limitaciones de los playgrounds

Los playgrounds son excelentes para practicar consultas basicas (SELECT, WHERE, JOINs, agregaciones), pero tienen limitaciones:

- No soportan todas las funcionalidades de PostgreSQL (transacciones, vistas materializadas, permisos, etc.)

- Las sesiones son temporales: los datos no se guardan entre visitas

- No puedes usar herramientas como

EXPLAIN ANALYZEo gestionar indices realmente

Para efectos profesionales y para cubrir todo el contenido del curso (especialmente los modulos avanzados), es necesario instalar PostgreSQL en tu maquina.

¿Que sigue?

Con el entorno listo y la base de datos cargada, en el proximo modulo vas a escribir tu primera consulta con SELECT. Vamos a explorar como pedirle datos a las tablas, eligiendo columnas, creando alias y haciendo calculos simples. ¡Vamos!

Ejercicios

Ejercicio 1: Verifica que tu entorno esta correctamente configurado. Abre un SQL Editor (Ctrl+]), asegurate de estar conectado a la base de datos tienda y ejecuta:

SELECT COUNT(*) FROM clientes;SELECT COUNT(*) FROM productos;SELECT COUNT(*) FROM pedidos;Ejecuta cada consulta poniendo el cursor en la linea y presionando Ctrl+Enter. ¿Cuantos registros tiene cada tabla?

Ejercicio 2: Ejecuta esta consulta y observa el resultado. No necesitas entenderla completamente aun, solo ejecutala con Ctrl+Enter:

SELECT nombre, precioFROM productosWHERE categoria = 'Electronica'ORDER BY precio DESC;¿Que crees que hace? Intenta describirlo con tus propias palabras.

Ejercicio 3: Modifica la consulta anterior cambiando 'Electronica' por 'Muebles'. ¿Que resultado obtienes?

Ejercicio 4: Usa el Database Navigator para explorar la base de datos. Expande tienda → Schemas → public → Tables y haz doble click en la tabla pedidos. Selecciona la pestaña Data. ¿Cuantas columnas tiene la tabla? ¿Que datos ves?

Ejercicio 5: Abre el diagrama ER de la base de datos. En el Navigator, haz doble click en Tables (el nodo que agrupa todas las tablas) y selecciona la pestaña Diagram. ¿Puedes identificar las relaciones entre las tablas? ¿Que tabla esta conectada con pedidos?

SELECT: Tu primera consulta

Prerequisito: base de datos de practica

Todos los ejemplos y ejercicios de este modulo (y los siguientes) se ejecutan sobre la base de datos tienda que creamos en el Modulo 2. Si aun no la tienes configurada, ve al Modulo 2 y sigue los pasos para crear las tablas y cargar los datos de ejemplo antes de continuar.

Tu primera consulta SQL

Llegamos al momento que estabas esperando: vas a hablar con la base de datos por primera vez. La instruccion mas fundamental de SQL es SELECT, y la vas a usar en absolutamente todo lo que hagas.

La forma mas basica de SELECT es:

SELECT columnasFROM tabla;Asi de simple. Le dices que columnas quieres y de que tabla. Probemos con nuestra base de datos:

SELECT nombre, precioFROM productos;Esta consulta devuelve el nombre y precio de todos los productos. El resultado se ve algo asi:

nombre | precio---------------------+--------- Laptop Pro 15 | 1299.99 Mouse Inalambrico | 29.99 Teclado Mecanico | 89.99 Monitor 27 pulgadas | 449.99 Auriculares Bluetooth| 59.99 ...Felicidades, acabas de hacer tu primera consulta SQL.

SELECT * vs columnas especificas

Existe un atajo para pedir todas las columnas de una tabla:

SELECT *FROM productos;El asterisco (*) significa “dame todas las columnas”. Es muy comodo para explorar datos rapidamente, pero tiene un problema importante en aplicaciones reales.

-- Esto trae TODAS las columnas: id, nombre, precio, categoria, stock, fecha_creacionSELECT *FROM productos;

-- Esto trae solo lo que necesitasSELECT nombre, precioFROM productos;¿Por que evitar SELECT * en produccion?

Cuando usas SELECT *, la base de datos tiene que leer y transferir todas las columnas de cada fila, incluso las que no necesitas. Si tu tabla tiene 20 columnas pero solo necesitas 3, estas transfiriendo casi 7 veces mas datos de los necesarios.

Piensalo asi: el trabajo por cada fila es proporcional al numero de columnas que pides. Si pides 3 columnas, es O(3) por fila. Si pides 20, es O(20) por fila. En una tabla con un millon de filas, esa diferencia se nota.

Ademas, SELECT * hace que tu codigo sea fragil: si alguien agrega una columna nueva a la tabla, tu consulta de repente devuelve datos que no esperabas.

¿Cuando si usar SELECT *?

Usa SELECT * libremente cuando estes explorando datos, aprendiendo la estructura de una tabla, o haciendo consultas rapidas en desarrollo. La recomendacion de evitarlo aplica sobre todo a consultas en aplicaciones en produccion.

Seleccionando columnas especificas

Puedes pedir una, dos o todas las columnas que quieras. El orden en que las pides es el orden en que aparecen en el resultado:

-- Solo el nombreSELECT nombreFROM clientes;

-- Nombre y ciudad (en ese orden)SELECT nombre, ciudadFROM clientes;

-- Ciudad primero, luego nombre (cambio de orden)SELECT ciudad, nombreFROM clientes;

-- Varias columnas de empleadosSELECT nombre, departamento, salarioFROM empleados;Observa que en el tercer ejemplo, la ciudad aparece antes que el nombre en el resultado. Tu controlas el orden de las columnas en la salida.

Alias de columnas con AS

A veces los nombres de las columnas no son muy descriptivos o quieres darles un nombre mas claro en el resultado. Para eso usamos AS:

SELECT nombre AS producto, precio AS precio_unitarioFROM productos;Resultado:

producto | precio_unitario----------------------+---------------- Laptop Pro 15 | 1299.99 Mouse Inalambrico | 29.99 Teclado Mecanico | 89.99 ...Los alias son especialmente utiles cuando haces calculos o cuando el nombre original de la columna no es claro:

SELECT nombre AS empleado, departamento AS area, salario AS sueldo_mensualFROM empleados;AS es opcional (pero usalo)

Tecnicamente puedes omitir la palabra AS y simplemente poner el alias:

SELECT nombre producto, precio costo FROM productos;Funciona, pero es mucho menos legible. Recomiendo siempre usar AS para que sea claro que estas creando un alias.

Alias con espacios

Si necesitas un alias con espacios, usa comillas dobles:

SELECT nombre AS "Nombre del Producto", precio AS "Precio en USD"FROM productos;DISTINCT: eliminando duplicados

Si una consulta devuelve valores repetidos y quieres ver solo los valores unicos, usa DISTINCT:

-- Sin DISTINCT: puede repetir ciudadesSELECT ciudadFROM clientes; ciudad----------- Santiago Valparaiso Santiago Concepcion Santiago Valparaiso Temuco Santiago Antofagasta Concepcion-- Con DISTINCT: cada ciudad aparece una sola vezSELECT DISTINCT ciudadFROM clientes; ciudad----------- Santiago Valparaiso Concepcion Temuco AntofagastaPuedes usar DISTINCT con multiples columnas. En ese caso, elimina filas donde la combinacion de columnas sea duplicada:

-- Combinaciones unicas de departamento y jefe_idSELECT DISTINCT departamento, jefe_idFROM empleados;Esto devuelve cada combinacion unica de departamento y jefe, no cada departamento unico y cada jefe unico por separado.

-- ¿Que categorias de productos tenemos?SELECT DISTINCT categoriaFROM productos; categoria------------ Electronica Muebles Accesorios-- ¿En que estados pueden estar los pedidos?SELECT DISTINCT estadoFROM pedidos; estado----------- completado enviado pendienteCosto de DISTINCT

DISTINCT no es gratis. Para eliminar duplicados, la base de datos necesita ordenar o agrupar todos los resultados y luego compararlos entre si. En tablas grandes esto puede ser costoso. Usalo cuando realmente necesites valores unicos, no “por si acaso”.

Expresiones y calculos en SELECT

SELECT no solo sirve para leer columnas tal cual estan. Puedes hacer calculos directamente en la consulta:

Aritmetica

-- Precio con IVA (19%)SELECT nombre, precio, precio * 1.19 AS precio_con_ivaFROM productos; nombre | precio | precio_con_iva---------------------+----------+--------------- Laptop Pro 15 | 1299.99 | 1547.39 Mouse Inalambrico | 29.99 | 35.69 Teclado Mecanico | 89.99 | 107.09 ...-- Valor total del inventario por productoSELECT nombre, precio, stock, precio * stock AS valor_inventarioFROM productos;-- Salario anual de empleados (asumiendo 12 meses)SELECT nombre, salario AS salario_mensual, salario * 12 AS salario_anualFROM empleados;-- Descuento del 10% en productosSELECT nombre, precio AS precio_original, precio * 0.10 AS descuento, precio * 0.90 AS precio_finalFROM productos;Concatenacion de texto

En PostgreSQL, usamos el operador || para unir texto:

SELECT nombre || ' - ' || ciudad AS cliente_infoFROM clientes; cliente_info---------------------------- Maria Garcia - Santiago Carlos Lopez - Valparaiso Ana Martinez - Santiago ...-- Descripcion del producto con precioSELECT nombre || ' ($' || precio || ')' AS descripcionFROM productos; descripcion----------------------------- Laptop Pro 15 ($1299.99) Mouse Inalambrico ($29.99) Teclado Mecanico ($89.99) ...Valores literales

Puedes incluir valores fijos (literales) en tu SELECT:

SELECT nombre, precio, 'CLP' AS moneda, 2024 AS anioFROM productos;Cada fila tendra las columnas moneda con el valor ‘CLP’ y anio con el valor 2024. Esto puede parecer inutil ahora, pero es muy practico cuando combinas datos de distintas fuentes.

SELECT sin FROM

Dato curioso: en PostgreSQL puedes usar SELECT sin una tabla, como una calculadora:

SELECT 2 + 2;-- Resultado: 4

SELECT 100 * 1.19 AS con_iva;-- Resultado: 119.00

SELECT 'Hola' || ' ' || 'Mundo' AS saludo;-- Resultado: Hola Mundo

SELECT NOW() AS fecha_actual;-- Resultado: 2024-04-20 15:30:00 (la fecha y hora actual)Es util para probar expresiones rapidamente sin necesidad de consultar una tabla.

El orden de escritura vs. el orden de ejecucion

Este es un concepto que te va a ahorrar muchos dolores de cabeza. El orden en que escribes una consulta SQL no es el orden en que la base de datos la ejecuta.

Tu escribes:

SELECT columnas -- 1° en escribirFROM tabla -- 2° en escribirWHERE condicion -- 3° en escribirPero la base de datos ejecuta:

FROM tabla -- 1° en ejecutar (primero encuentra la tabla)WHERE condicion -- 2° en ejecutar (luego filtra filas)SELECT columnas -- 3° en ejecutar (al final elige columnas)¿Por que importa esto?

Esto explica, por ejemplo, por que no puedes usar un alias definido en SELECT dentro del WHERE: cuando el WHERE se ejecuta, el SELECT todavia no ha corrido.

-- Esto NO funciona:SELECT precio * 1.19 AS precio_con_ivaFROM productosWHERE precio_con_iva > 100; -- Error: precio_con_iva no existe aun

-- Esto SI funciona:SELECT precio * 1.19 AS precio_con_ivaFROM productosWHERE precio * 1.19 > 100; -- Repites la expresionEn modulos posteriores veremos el orden completo de ejecucion cuando agreguemos mas clausulas.

Buenas practicas al escribir SELECT

Antes de pasar a los ejercicios, algunas recomendaciones:

-- MAL: todo en una linea, dificil de leerSELECT nombre,precio,stock,precio*stock AS total FROM productos;

-- BIEN: cada columna en su linea, con indentacion claraSELECT nombre, precio, stock, precio * stock AS totalFROM productos;-- MAL: columnas ambiguas, sin aliasSELECT nombre, precio * 1.19, stock * precioFROM productos;

-- BIEN: alias descriptivos para cada calculoSELECT nombre, precio * 1.19 AS precio_con_iva, stock * precio AS valor_inventarioFROM productos;SQL no distingue mayusculas

Las palabras clave de SQL (SELECT, FROM, WHERE, etc.) funcionan en mayusculas o minusculas. select, SELECT y Select son lo mismo. La convencion mas comun es escribir las palabras clave en MAYUSCULAS para distinguirlas de los nombres de tablas y columnas. En este curso usamos esa convencion.

Ejercicios

Ejercicio 1: Escribe una consulta que muestre el nombre y la categoria de todos los productos.

Ver solucion

SELECT nombre, categoriaFROM productos;Ejercicio 2: Muestra el nombre de cada producto junto con su precio con IVA (19%) y ponle un alias descriptivo a la nueva columna.

Ver solucion

SELECT nombre, precio, precio * 1.19 AS precio_con_ivaFROM productos;Ejercicio 3: Obtener una lista de todas las ciudades unicas donde tenemos clientes.

Ver solucion

SELECT DISTINCT ciudadFROM clientes;Ejercicio 4: Muestra el nombre completo de cada cliente concatenado con su email entre parentesis. Por ejemplo: “Maria Garcia (maria@email.com)”. Usa un alias llamado contacto.

Ver solucion

SELECT nombre || ' (' || email || ')' AS contactoFROM clientes;Ejercicio 5: Para cada producto, muestra su nombre, stock actual, precio y el valor total del inventario (stock multiplicado por precio). Usa alias descriptivos.

Ver solucion

SELECT nombre, stock AS unidades_disponibles, precio AS precio_unitario, stock * precio AS valor_total_inventarioFROM productos;Ejercicio 6: Obtener los departamentos unicos de la tabla empleados. ¿Cuantos departamentos distintos hay?

Ver solucion

SELECT DISTINCT departamentoFROM empleados;-- Resultado: Gerencia, Ventas, Tecnologia, Soporte (4 departamentos)Ejercicio 7: Muestra el nombre de cada empleado, su salario mensual y su salario anual (12 meses). Ademas agrega una columna literal que diga ‘CLP’ como moneda.

Ver solucion

SELECT nombre, salario AS salario_mensual, salario * 12 AS salario_anual, 'CLP' AS monedaFROM empleados;Ejercicio 8 (desafio): Sin ejecutar la consulta, ¿esta consulta va a funcionar? ¿Por que si o por que no?

SELECT nombre, precio * stock AS valorFROM productosWHERE valor > 1000;Ver solucion

No funciona. El alias valor se define en el SELECT, pero el WHERE se ejecuta antes que el SELECT. La base de datos no conoce el alias valor cuando evalua el WHERE. La forma correcta seria:

SELECT nombre, precio * stock AS valorFROM productosWHERE precio * stock > 1000;WHERE: Filtrando datos

Filtrando datos con WHERE

En el modulo anterior aprendimos a pedir columnas con SELECT. Pero SELECT sin WHERE es como ir al supermercado y traer todo lo que hay en la tienda. En la vida real, casi siempre quieres solo una parte de los datos.

La clausula WHERE te permite filtrar filas segun condiciones:

SELECT nombre, precioFROM productosWHERE categoria = 'Electronica';Esta consulta dice: “dame el nombre y precio de los productos, pero solo los que tienen categoria Electronica”. El resultado:

nombre | precio-----------------------+--------- Laptop Pro 15 | 1299.99 Mouse Inalambrico | 29.99 Teclado Mecanico | 89.99 Monitor 27 pulgadas | 449.99 Auriculares Bluetooth | 59.99 Webcam HD | 79.99De los 15 productos en la tabla, solo 6 cumplen la condicion. El WHERE descarto los otros 9 antes de que llegaran al resultado.

WHERE: tu mejor aliado en rendimiento

WHERE es probablemente la clausula mas importante para el rendimiento de tus consultas. Filtrar filas temprano significa que el resto de la consulta (ordenar, agrupar, calcular) trabaja con menos datos. Si tu tabla tiene un millon de filas y el WHERE las reduce a 100, todo lo demas es 10,000 veces mas rapido. Siempre filtra lo mas posible, lo antes posible.

Operadores de comparacion

Los operadores basicos de comparacion son los que ya conoces de matematicas:

-- Igual aSELECT nombre, precioFROM productosWHERE precio = 29.99;

-- Diferente de (no igual)SELECT nombre, estadoFROM pedidosWHERE estado <> 'completado';

-- Mayor queSELECT nombre, precioFROM productosWHERE precio > 100;

-- Menor queSELECT nombre, salarioFROM empleadosWHERE salario < 45000;

-- Mayor o igual queSELECT nombre, stockFROM productosWHERE stock >= 100;

-- Menor o igual queSELECT nombre, precioFROM productosWHERE precio <= 50;Veamos un ejemplo mas detallado. Queremos los productos que cuestan mas de $100:

SELECT nombre, precio, categoriaFROM productosWHERE precio > 100; nombre | precio | categoria-----------------------+----------+------------ Laptop Pro 15 | 1299.99 | Electronica Monitor 27 pulgadas | 449.99 | Electronica Escritorio Ajustable | 399.99 | Muebles Silla Ergonomica | 299.99 | MueblesLos operadores de comparacion tambien funcionan con texto y fechas:

-- Clientes registrados despues de una fechaSELECT nombre, fecha_registroFROM clientesWHERE fecha_registro > '2024-01-01';

-- Pedidos con total exactoSELECT id, total, estadoFROM pedidosWHERE total = 89.99;

-- Empleados que NO son del departamento de VentasSELECT nombre, departamentoFROM empleadosWHERE departamento <> 'Ventas';Comparacion de texto

Cuando comparas texto con =, la comparacion es exacta. 'Santiago' no es igual a 'santiago' ni a 'Santiago ' (con un espacio extra). Mas adelante veremos ILIKE para busquedas mas flexibles.

Operadores logicos: AND, OR, NOT

¿Que pasa si necesitas combinar varias condiciones? Usas los operadores logicos.

AND: ambas condiciones deben cumplirse

-- Productos de Electronica que cuesten menos de $100SELECT nombre, precio, categoriaFROM productosWHERE categoria = 'Electronica' AND precio < 100; nombre | precio | categoria-----------------------+--------+------------ Mouse Inalambrico | 29.99 | Electronica Teclado Mecanico | 89.99 | Electronica Auriculares Bluetooth | 59.99 | Electronica Webcam HD | 79.99 | ElectronicaAmbas condiciones deben ser verdaderas: el producto tiene que ser de Electronica y costar menos de 100.

-- Empleados de Tecnologia con salario mayor a 55000SELECT nombre, departamento, salarioFROM empleadosWHERE departamento = 'Tecnologia' AND salario > 55000; nombre | departamento | salario---------------------+--------------+--------- Miguel Angel Torres | Tecnologia | 62000 Alejandro Vega | Tecnologia | 58000OR: al menos una condicion debe cumplirse

-- Productos que sean de Electronica O de MueblesSELECT nombre, precio, categoriaFROM productosWHERE categoria = 'Electronica' OR categoria = 'Muebles';Esto devuelve los productos que cumplan cualquiera de las dos condiciones: si es de Electronica, entra. Si es de Muebles, tambien entra.

-- Pedidos que esten pendientes o enviadosSELECT id, fecha, total, estadoFROM pedidosWHERE estado = 'pendiente' OR estado = 'enviado'; id | fecha | total | estado----+------------+---------+----------- 5 | 2024-02-28 | 1749.98 | enviado 7 | 2024-03-10 | 299.99 | pendiente 8 | 2024-03-15 | 839.98 | enviado 10 | 2024-03-25 | 479.98 | pendiente 12 | 2024-04-05 | 1299.99 | enviado 13 | 2024-04-10 | 69.98 | pendienteNOT: invierte la condicion

-- Productos que NO son de ElectronicaSELECT nombre, categoriaFROM productosWHERE NOT categoria = 'Electronica';-- Equivalente a: WHERE categoria <> 'Electronica'NOT es mas util cuando lo combinas con otros operadores como IN, BETWEEN o LIKE, que veremos en un momento.

Precedencia: AND antes que OR

Aqui viene un error clasico que atrapa a muchos principiantes. AND tiene mayor precedencia que OR, igual que la multiplicacion tiene mayor precedencia que la suma en matematicas.

-- CUIDADO: ¿que hace realmente esta consulta?SELECT nombre, precio, categoriaFROM productosWHERE categoria = 'Electronica' OR categoria = 'Muebles' AND precio < 50;Esto NO dice “productos de Electronica o Muebles que cuesten menos de 50”. Lo que realmente dice es:

-- Asi lo interpreta la base de datos:WHERE categoria = 'Electronica' OR (categoria = 'Muebles' AND precio < 50)Es decir: “dame TODOS los de Electronica (sin importar precio) O los de Muebles que cuesten menos de 50”. El AND se evalua primero y solo se aplica a Muebles.

La solucion: usa parentesis para ser explicito:

-- Esto SI hace lo que quieres:SELECT nombre, precio, categoriaFROM productosWHERE (categoria = 'Electronica' OR categoria = 'Muebles') AND precio < 50; nombre | precio | categoria-------------------+--------+------------ Mouse Inalambrico | 29.99 | Electronica Lampara LED | 34.99 | Muebles Soporte Monitor | 44.99 | MueblesSiempre usa parentesis

Cuando combines AND y OR en la misma consulta, siempre usa parentesis. Incluso si recuerdas las reglas de precedencia, los parentesis hacen que tu intencion sea clara para cualquier persona que lea la consulta (incluyendo tu yo del futuro).

BETWEEN: rangos de valores

BETWEEN es un atajo elegante para filtrar por un rango (incluyendo los extremos):

-- Productos entre $30 y $100 (incluye 30 y 100)SELECT nombre, precioFROM productosWHERE precio BETWEEN 30 AND 100; nombre | precio-----------------------+-------- Teclado Mecanico | 89.99 Auriculares Bluetooth | 59.99 Lampara LED | 34.99 Mochila para Laptop | 49.99 Hub USB-C | 39.99 Webcam HD | 79.99 Soporte Monitor | 44.99Es equivalente a escribir:

WHERE precio >= 30 AND precio <= 100Pero BETWEEN es mas legible. Funciona tambien con fechas:

-- Pedidos realizados en febrero 2024SELECT id, cliente_id, fecha, totalFROM pedidosWHERE fecha BETWEEN '2024-02-01' AND '2024-02-28'; id | cliente_id | fecha | total----+------------+------------+--------- 3 | 3 | 2024-02-01 | 499.98 4 | 1 | 2024-02-14 | 59.99 5 | 4 | 2024-02-28 | 1749.98-- Empleados con salario entre 40000 y 60000SELECT nombre, departamento, salarioFROM empleadosWHERE salario BETWEEN 40000 AND 60000;Y puedes invertirlo con NOT:

-- Productos que NO cuestan entre 30 y 100SELECT nombre, precioFROM productosWHERE precio NOT BETWEEN 30 AND 100;BETWEEN incluye los extremos

BETWEEN 30 AND 100 incluye tanto 30 como 100. Si necesitas excluir los extremos, usa operadores de comparacion: WHERE precio > 30 AND precio < 100.

IN: listas de valores

Cuando necesitas comparar contra varios valores posibles, IN es mucho mas limpio que encadenar varios OR:

-- Sin IN (funciona pero es verboso)SELECT nombre, ciudadFROM clientesWHERE ciudad = 'Santiago' OR ciudad = 'Valparaiso' OR ciudad = 'Concepcion';

-- Con IN (mismo resultado, mucho mas limpio)SELECT nombre, ciudadFROM clientesWHERE ciudad IN ('Santiago', 'Valparaiso', 'Concepcion'); nombre | ciudad-----------------+------------ Maria Garcia | Santiago Carlos Lopez | Valparaiso Ana Martinez | Santiago Pedro Sanchez | Concepcion Laura Torres | Santiago Diego Rivera | Valparaiso Roberto Diaz | Santiago Andres Vargas | ConcepcionIN funciona con cualquier tipo de dato:

-- Productos de ciertas categoriasSELECT nombre, categoria, precioFROM productosWHERE categoria IN ('Electronica', 'Accesorios');

-- Pedidos especificos por IDSELECT id, total, estadoFROM pedidosWHERE id IN (1, 5, 10, 15);

-- Pedidos que no estan completados ni enviadosSELECT id, total, estadoFROM pedidosWHERE estado NOT IN ('completado', 'enviado');IN vs OR: mismo resultado

WHERE ciudad IN ('Santiago', 'Valparaiso') produce exactamente el mismo resultado que WHERE ciudad = 'Santiago' OR ciudad = 'Valparaiso'. Internamente PostgreSQL puede incluso convertir uno al otro. La ventaja de IN es puramente de legibilidad, especialmente con listas largas.

LIKE e ILIKE: busqueda por patrones

A veces no sabes el valor exacto que buscas. LIKE te permite buscar usando patrones con dos caracteres especiales:

%representa cualquier cantidad de caracteres (cero o mas)_representa exactamente un caracter

-- Productos cuyo nombre empieza con "M"SELECT nombreFROM productosWHERE nombre LIKE 'M%'; nombre------------------- Mouse Inalambrico Monitor 27 pulgadas Mochila para Laptop Mousepad XL-- Productos cuyo nombre termina en "o"SELECT nombreFROM productosWHERE nombre LIKE '%o'; nombre------------------- Mouse Inalambrico Teclado Mecanico-- Productos que contienen "USB" en el nombreSELECT nombreFROM productosWHERE nombre LIKE '%USB%'; nombre----------- Hub USB-C-- Emails que contienen un texto especificoSELECT nombre, emailFROM clientesWHERE email LIKE '%@email.com';El guion bajo (_) es para un solo caracter:

-- Nombres de exactamente 4 letras (patron: 4 guiones bajos)-- Esto buscaria nombres de exactamente 4 caracteresSELECT nombreFROM clientesWHERE nombre LIKE '____';ILIKE: busqueda sin importar mayusculas/minusculas

LIKE es sensible a mayusculas. Si buscas LIKE 'laptop%', no encontrara “Laptop Pro 15”. Para buscar sin distinguir mayusculas, PostgreSQL tiene ILIKE:

-- LIKE: sensible a mayusculas (no encuentra nada)SELECT nombreFROM productosWHERE nombre LIKE 'laptop%';-- Resultado: 0 filas

-- ILIKE: ignora mayusculas/minusculasSELECT nombreFROM productosWHERE nombre ILIKE 'laptop%';-- Resultado: Laptop Pro 15-- Buscar clientes cuyo nombre contiene "garcia" (sin importar mayusculas)SELECT nombre, emailFROM clientesWHERE nombre ILIKE '%garcia%'; nombre | email---------------+---------------- Maria Garcia | maria@email.comILIKE es exclusivo de PostgreSQL

ILIKE no existe en el estandar SQL ni en otros motores como MySQL o SQL Server. Es una extension de PostgreSQL. En otros motores se logra de forma distinta (por ejemplo, MySQL compara texto sin distinguir mayusculas por defecto).

LIKE y el uso de indices

Cuando usas LIKE con un patron que empieza con % (como '%laptop%'), la base de datos no puede usar un indice y tiene que revisar todas las filas de la tabla. Esto es lo que llamamos un full table scan.

En cambio, si el patron empieza con texto fijo (como 'Laptop%'), PostgreSQL puede usar un indice para saltar directamente a las filas que empiezan con “Laptop”, lo cual es mucho mas rapido.

Regla general: LIKE 'texto%' puede ser rapido con un indice. LIKE '%texto%' siempre revisa toda la tabla.

IS NULL / IS NOT NULL

En bases de datos, NULL es un valor especial que significa “no hay dato” o “desconocido”. No es lo mismo que cero, no es lo mismo que una cadena vacia, y no es lo mismo que false. Es la ausencia de valor.

Un detalle importante: no puedes comparar con NULL usando =. Tienes que usar IS NULL o IS NOT NULL:

-- INCORRECTO: esto no funciona como esperasSELECT nombreFROM empleadosWHERE jefe_id = NULL;-- Resultado: 0 filas (siempre, incluso si hay NULLs)

-- CORRECTO: usa IS NULLSELECT nombreFROM empleadosWHERE jefe_id IS NULL;-- Resultado: Sofia Mendez (la gerente, no tiene jefe)¿Por que = NULL no funciona? Porque en SQL, cualquier comparacion con NULL devuelve NULL (ni verdadero ni falso). Es como preguntar “¿es lo desconocido igual a lo desconocido?” La respuesta es: no se sabe.

-- Empleados que SI tienen jefeSELECT nombre, jefe_idFROM empleadosWHERE jefe_id IS NOT NULL; nombre | jefe_id---------------------+--------- Juan Perez | 1 Valentina Castro | 1 Miguel Angel Torres | 1 Camila Rojas | 4 Alejandro Vega | 4 Fernanda Luna | 2 Ricardo Soto | 4 Patricia Herrera | 8 Daniela Flores | 2La trampa del NULL

Este es uno de los errores mas comunes en SQL. Recuerda estas reglas:

NULL = NULLdevuelve NULL (no TRUE)NULL <> NULLdevuelve NULL (no TRUE)NULL > 5devuelve NULL- Para verificar NULL, siempre usa

IS NULLoIS NOT NULL

Combinando todo

Ahora que conoces todas las herramientas de filtrado, puedes combinarlas para hacer consultas precisas:

-- Productos de Electronica entre $50 y $500 con stock mayor a 30SELECT nombre, precio, stockFROM productosWHERE categoria = 'Electronica' AND precio BETWEEN 50 AND 500 AND stock > 30; nombre | precio | stock-----------------------+--------+------- Teclado Mecanico | 89.99 | 80 Auriculares Bluetooth | 59.99 | 200 Webcam HD | 79.99 | 60-- Clientes de Santiago o Valparaiso cuyos nombres empiezan con 'C' o 'M'SELECT nombre, ciudad, emailFROM clientesWHERE ciudad IN ('Santiago', 'Valparaiso') AND (nombre LIKE 'C%' OR nombre LIKE 'M%'); nombre | ciudad | email-----------------+-------------+---------------- Maria Garcia | Santiago | maria@email.com Carlos Lopez | Valparaiso | carlos@email.com-- Pedidos completados de mas de $100 en el primer trimestre de 2024SELECT id, cliente_id, fecha, totalFROM pedidosWHERE estado = 'completado' AND total > 100 AND fecha BETWEEN '2024-01-01' AND '2024-03-31';-- Empleados que no son de Ventas ni de Soporte y ganan mas de 50000SELECT nombre, departamento, salarioFROM empleadosWHERE departamento NOT IN ('Ventas', 'Soporte') AND salario > 50000;Filtrar temprano, filtrar mucho

Imagina una tabla con 10 millones de filas. Si tu WHERE reduce eso a 1000 filas, cualquier operacion posterior (ordenar, agrupar, hacer JOINs) trabaja con 1000 filas en vez de 10 millones.

Conceptualmente, una consulta sin WHERE sobre una tabla de N filas tiene que procesar las N filas completas. Un WHERE con una condicion sobre una columna indexada puede encontrar las filas relevantes en tiempo logaritmico, es decir O(log N) en vez de O(N). Veremos indices mas adelante, pero la leccion por ahora es: cada condicion en WHERE que reduce filas mejora el rendimiento de toda la consulta.

Resumen de operadores

Aqui tienes una referencia rapida de todo lo que vimos:

| Operador | Descripcion | Ejemplo |

|---|---|---|

= | Igual a | WHERE precio = 29.99 |

<> o != | Diferente de | WHERE estado <> 'pendiente' |

> | Mayor que | WHERE precio > 100 |

< | Menor que | WHERE stock < 50 |

>= | Mayor o igual | WHERE salario >= 45000 |

<= | Menor o igual | WHERE precio <= 50 |

AND | Ambas condiciones | WHERE precio > 10 AND stock > 0 |

OR | Al menos una condicion | WHERE ciudad = 'Santiago' OR ciudad = 'Temuco' |

NOT | Invierte la condicion | WHERE NOT categoria = 'Muebles' |

BETWEEN | Rango inclusivo | WHERE precio BETWEEN 10 AND 100 |

IN | Lista de valores | WHERE ciudad IN ('Santiago', 'Temuco') |

LIKE | Patron (sensible a mayusculas) | WHERE nombre LIKE 'M%' |

ILIKE | Patron (sin distinguir mayusculas) | WHERE nombre ILIKE '%laptop%' |

IS NULL | Es nulo | WHERE jefe_id IS NULL |

IS NOT NULL | No es nulo | WHERE email IS NOT NULL |

Ejercicios

Ejercicio 1: Encuentra todos los productos que cuestan menos de $50.

Ver solucion

SELECT nombre, precioFROM productosWHERE precio < 50;Ejercicio 2: Muestra los pedidos con estado ‘enviado’ que tengan un total mayor a $500.

Ver solucion

SELECT id, cliente_id, fecha, total, estadoFROM pedidosWHERE estado = 'enviado' AND total > 500;Ejercicio 3: Encuentra todos los clientes que NO viven en Santiago.

Ver solucion

SELECT nombre, ciudadFROM clientesWHERE ciudad <> 'Santiago';-- Tambien valido: WHERE NOT ciudad = 'Santiago'-- Tambien valido: WHERE ciudad NOT IN ('Santiago')Ejercicio 4: Busca los productos cuyo nombre contiene la palabra “Monitor” (sin importar mayusculas o minusculas).

Ver solucion

SELECT nombre, precio, categoriaFROM productosWHERE nombre ILIKE '%monitor%';Ejercicio 5: Encuentra empleados del departamento de Tecnologia o Ventas que ganen entre 40000 y 60000.

Ver solucion

SELECT nombre, departamento, salarioFROM empleadosWHERE departamento IN ('Tecnologia', 'Ventas') AND salario BETWEEN 40000 AND 60000;Ejercicio 6: Muestra los pedidos realizados en marzo de 2024 que esten pendientes o enviados.

Ver solucion

SELECT id, cliente_id, fecha, total, estadoFROM pedidosWHERE fecha BETWEEN '2024-03-01' AND '2024-03-31' AND estado IN ('pendiente', 'enviado');Ejercicio 7: Encuentra al empleado (o empleados) que no tiene jefe. ¿Que cargo crees que tiene esa persona?

Ver solucion

SELECT nombre, departamento, salarioFROM empleadosWHERE jefe_id IS NULL;-- Resultado: Sofia Mendez, del departamento Gerencia.-- Es la gerente general, la unica sin jefe.Ejercicio 8 (desafio): Escribe una consulta que encuentre productos de la categoria ‘Accesorios’ que cuesten menos de $30 O productos de cualquier categoria con stock mayor a 200. Asegurate de que los parentesis esten correctos.

Ver solucion

SELECT nombre, precio, categoria, stockFROM productosWHERE (categoria = 'Accesorios' AND precio < 30) OR stock > 200;Los parentesis son clave aqui. Sin ellos, el AND se evaluaria primero y el resultado seria diferente. Los productos que cumplen son:

- Cable HDMI 2m ($12.99, Accesorios) - cumple la primera condicion

- Mousepad XL ($19.99, Accesorios) - cumple la primera condicion

- Cargador Rapido ($24.99, Accesorios) - cumple la primera condicion

- Cable HDMI 2m tambien cumple la segunda (stock: 300)

- Cargador Rapido tambien cumple la segunda (stock: 250)

Ordenar y paginar resultados

Hasta ahora sabemos seleccionar columnas y filtrar filas. Pero los resultados nos llegan en cualquier orden. En este modulo vamos a aprender a ordenar los resultados y a paginarlos para no traer todo de golpe.

ORDER BY: Ordenando resultados

Por defecto, SQL no garantiza ningun orden en los resultados. Si quieres un orden especifico, debes pedirlo explicitamente con ORDER BY.

SELECT nombre, precioFROM productosORDER BY precio;Esto te devuelve los productos ordenados por precio de menor a mayor (ascendente). Es el comportamiento por defecto.

ASC y DESC

Puedes ser explicito con la direccion del ordenamiento:

-- Ascendente (por defecto)SELECT nombre, precioFROM productosORDER BY precio ASC;

-- Descendente: del mas caro al mas baratoSELECT nombre, precioFROM productosORDER BY precio DESC;Un ejemplo practico: quieres ver los clientes mas recientes primero.

SELECT nombre, email, fecha_registroFROM clientesORDER BY fecha_registro DESC;Consejo practico

ORDER BY columna DESC es muy comun cuando quieres ver “lo mas reciente primero” o “lo mas grande primero”. Lo vas a usar todo el tiempo.

Ordenar por multiples columnas

Puedes ordenar por varias columnas. SQL ordena primero por la primera columna, y cuando hay empates, usa la segunda columna para desempatar.

SELECT nombre, categoria, precioFROM productosORDER BY categoria ASC, precio DESC;Esto agrupa los productos por categoria (alfabeticamente) y dentro de cada categoria los ordena del mas caro al mas barato. Piensa en ello como: “primero ordena por categoria, y si dos productos tienen la misma categoria, desempata por precio.”

Otro ejemplo: ordenar pedidos por estado y luego por fecha.

SELECT id, cliente_id, estado, fecha, totalFROM pedidosORDER BY estado ASC, fecha DESC;Asi ves todos los pedidos “completado” juntos (los mas recientes primero), luego los “pendiente”, etc.

ORDER BY con numero de posicion

En vez de escribir el nombre de la columna, puedes usar el numero de posicion en el SELECT:

SELECT nombre, precio, categoriaFROM productosORDER BY 3, 2 DESC;Aqui 3 se refiere a categoria (la tercera columna en el SELECT) y 2 se refiere a precio.

Cuidado con los numeros de posicion

Esto funciona, pero hace tu consulta mas dificil de leer. Si alguien cambia el orden de las columnas en el SELECT, el ORDER BY se rompe silenciosamente. Prefiere usar nombres de columnas siempre que puedas.

LIMIT: Restringir la cantidad de resultados

No siempre quieres todos los resultados. LIMIT te permite decir “dame solo los primeros N”.

-- Los 5 productos mas carosSELECT nombre, precioFROM productosORDER BY precio DESCLIMIT 5;-- Los 3 clientes mas recientesSELECT nombre, email, fecha_registroFROM clientesORDER BY fecha_registro DESCLIMIT 3;Nota

LIMIT sin ORDER BY te da N filas “cualesquiera”. Como SQL no garantiza orden, no sabes cuales te va a dar. Casi siempre quieres usar LIMIT junto con ORDER BY.

OFFSET: Saltarse filas

OFFSET le dice a la base de datos “saltate las primeras N filas”.

-- Saltate los primeros 5 productos y dame los siguientes 5SELECT nombre, precioFROM productosORDER BY precio DESCLIMIT 5 OFFSET 5;Esto te da los productos del puesto 6 al 10 (ordenados por precio descendente).

El patron LIMIT + OFFSET para paginacion

Este es uno de los patrones mas usados en aplicaciones web. Imagina que tienes una pagina de productos con 10 productos por pagina:

-- Pagina 1 (productos 1-10)SELECT nombre, precio, categoriaFROM productosORDER BY nombreLIMIT 10 OFFSET 0;

-- Pagina 2 (productos 11-20)SELECT nombre, precio, categoriaFROM productosORDER BY nombreLIMIT 10 OFFSET 10;

-- Pagina 3 (productos 21-30)SELECT nombre, precio, categoriaFROM productosORDER BY nombreLIMIT 10 OFFSET 20;La formula general es: OFFSET = (numero_pagina - 1) * elementos_por_pagina.

Formula de paginacion

Para la pagina P mostrando N elementos: LIMIT N OFFSET (P - 1) * N

NULLS FIRST y NULLS LAST

Cuando ordenas una columna que tiene valores NULL, PostgreSQL los pone al final por defecto en orden ascendente. Puedes controlar esto:

-- NULLs primeroSELECT nombre, precioFROM productosORDER BY precio ASC NULLS FIRST;

-- NULLs al final (explicitamente)SELECT nombre, precioFROM productosORDER BY precio ASC NULLS LAST;

-- Con DESC, por defecto los NULLs van primero.-- Si quieres cambiar eso:SELECT nombre, precioFROM productosORDER BY precio DESC NULLS LAST;Comportamiento por defecto

En PostgreSQL: ASC pone los NULL al final, DESC los pone al principio. Con NULLS FIRST / NULLS LAST puedes forzar la posicion que prefieras.

Combinando todo

Veamos un ejemplo completo que combina lo que hemos aprendido:

-- Los 10 pedidos mas recientes de estado 'completado',-- ordenados por total descendenteSELECT p.id, c.nombre AS cliente, p.fecha, p.totalFROM pedidos pJOIN clientes c ON p.cliente_id = c.idWHERE p.estado = 'completado'ORDER BY p.total DESC, p.fecha DESCLIMIT 10;No te preocupes por el JOIN todavia (lo veremos en el Modulo 7). Lo importante aqui es ver como WHERE, ORDER BY y LIMIT trabajan juntos.

Rendimiento y complejidad

Vamos a hablar de algo que muchos cursos ignoran: que tan costosas son estas operaciones.

Costo de ORDER BY

ORDER BY requiere ordenar todos los resultados. La complejidad de un ordenamiento es O(n log n) donde n es el numero de filas a ordenar. En tablas pequenas no lo notas, pero si tienes millones de filas, ordenar puede ser muy lento.

LIMIT ayuda… pero tiene limites

Cuando usas LIMIT, la base de datos puede hacer una optimizacion: no necesita ordenar todo, solo encontrar los primeros N elementos. Esto es mas rapido.

-- PostgreSQL puede optimizar esto: no ordena todo,-- solo busca los 10 mas grandesSELECT nombre, precioFROM productosORDER BY precio DESCLIMIT 10;El problema de la paginacion profunda con OFFSET

Aqui viene el problema serio. Mira estas dos consultas:

-- Pagina 1: rapidaSELECT * FROM productos ORDER BY id LIMIT 10 OFFSET 0;

-- Pagina 100,000: MUY lentaSELECT * FROM productos ORDER BY id LIMIT 10 OFFSET 999990;La segunda consulta parece inocente, pero la base de datos tiene que leer y descartar 999,990 filas antes de darte las 10 que pides. El OFFSET es O(n) - tiene que recorrer todas esas filas aunque no las devuelva.

OFFSET profundo es lento

OFFSET 1000000 significa que la base de datos lee un millon de filas para descartarlas. No importa que tu LIMIT sea solo 10. Cuanto mas profunda la paginacion, mas lenta la consulta.

Alternativa: paginacion por keyset (cursor)

La solucion profesional para paginacion profunda es usar keyset pagination (paginacion por cursor). En vez de decir “saltate N filas”, dices “dame filas despues de este valor”:

-- En vez de OFFSET, usamos WHERE con el ultimo ID visto-- Supongamos que el ultimo producto de la pagina anterior tenia id = 500SELECT id, nombre, precioFROM productosWHERE id > 500ORDER BY idLIMIT 10;Esto es O(log n) si id tiene un indice (casi siempre lo tiene). No importa si estas en la pagina 1 o en la pagina 100,000, la velocidad es la misma.

Cuando usar cada patron

- LIMIT + OFFSET: Perfecto para pocas paginas (menos de ~100 paginas). Simple de implementar.

- Keyset pagination: Necesario cuando tienes muchos datos y el usuario puede navegar a paginas profundas. Mas complejo pero mucho mas eficiente.

Ejercicios

Practica con estas consultas usando la base de datos del curso.

Ejercicio 1: Muestra todos los productos ordenados por precio de mayor a menor. Muestra nombre, precio y categoria.

Ver solucion

SELECT nombre, precio, categoriaFROM productosORDER BY precio DESC;Ejercicio 2: Muestra los 5 clientes mas antiguos (los que se registraron primero). Muestra su nombre, email y fecha de registro.

Ver solucion

SELECT nombre, email, fecha_registroFROM clientesORDER BY fecha_registro ASCLIMIT 5;Ejercicio 3: Muestra los productos ordenados por categoria (ascendente) y dentro de cada categoria por precio (descendente). Limita a 20 resultados.

Ver solucion

SELECT nombre, categoria, precioFROM productosORDER BY categoria ASC, precio DESCLIMIT 20;Ejercicio 4: Simula la pagina 3 de un listado de pedidos (10 pedidos por pagina), ordenados por fecha descendente. Muestra id, fecha, total y estado.

Ver solucion

SELECT id, fecha, total, estadoFROM pedidosORDER BY fecha DESCLIMIT 10 OFFSET 20;Pagina 3 con 10 elementos por pagina: OFFSET = (3 - 1) * 10 = 20

Ejercicio 5: Muestra los 3 pedidos con el total mas alto que esten en estado ‘pendiente’.

Ver solucion

SELECT id, cliente_id, fecha, totalFROM pedidosWHERE estado = 'pendiente'ORDER BY total DESCLIMIT 3;Ejercicio 6 (Desafio): Escribe una consulta con keyset pagination. Supongamos que ya viste productos con id hasta el 50. Trae los siguientes 10 productos ordenados por id.

Ver solucion

SELECT id, nombre, precio, categoriaFROM productosWHERE id > 50ORDER BY id ASCLIMIT 10;Esto es mucho mas eficiente que OFFSET 50 para tablas grandes, ya que usa el indice de la columna id directamente.

Funciones de agregacion

Hasta ahora hemos trabajado con filas individuales: seleccionar, filtrar, ordenar. Pero muchas veces necesitas resumenes: cuantos productos hay, cual es el precio promedio, cuanto se vendio en total. Para eso existen las funciones de agregacion.

Las funciones basicas de agregacion

COUNT: Contar filas

COUNT cuenta el numero de filas. Tiene varias formas:

-- Contar TODAS las filas de la tablaSELECT COUNT(*) FROM productos;

-- Contar filas donde la columna NO es NULLSELECT COUNT(email) FROM clientes;

-- Contar valores DISTINTOSSELECT COUNT(DISTINCT categoria) FROM productos;COUNT(*) vs COUNT(columna)

COUNT(*) cuenta todas las filas, incluyendo las que tienen NULLs. COUNT(columna) solo cuenta filas donde esa columna no es NULL. COUNT(DISTINCT columna) cuenta valores unicos (sin repetir).

Veamos ejemplos mas concretos:

-- Cuantos clientes tenemos?SELECT COUNT(*) AS total_clientes FROM clientes;

-- Cuantas ciudades distintas tienen nuestros clientes?SELECT COUNT(DISTINCT ciudad) AS ciudades FROM clientes;

-- Cuantos pedidos estan pendientes?SELECT COUNT(*) AS pendientesFROM pedidosWHERE estado = 'pendiente';SUM: Sumar valores

SUM suma todos los valores de una columna numerica.

-- Total de ingresos por pedidos completadosSELECT SUM(total) AS ingresos_totalesFROM pedidosWHERE estado = 'completado';

-- Stock total de todos los productosSELECT SUM(stock) AS stock_total FROM productos;AVG: Promedio

AVG calcula el promedio (la media aritmetica).

-- Precio promedio de los productosSELECT AVG(precio) AS precio_promedio FROM productos;

-- Salario promedio de los empleadosSELECT AVG(salario) AS salario_promedio FROM empleados;

-- Promedio del total de los pedidosSELECT AVG(total) AS pedido_promedio FROM pedidos;Redondear el resultado

AVG suele devolver muchos decimales. Puedes usar ROUND para limitar: ROUND(AVG(precio), 2) te da 2 decimales.

MIN y MAX: Extremos

-- Producto mas barato y mas caroSELECT MIN(precio) AS precio_minimo, MAX(precio) AS precio_maximoFROM productos;

-- Primer y ultimo registro de clientesSELECT MIN(fecha_registro) AS primer_cliente, MAX(fecha_registro) AS ultimo_clienteFROM clientes;

-- El pedido mas grandeSELECT MAX(total) AS pedido_mas_grande FROM pedidos;Combinando varias funciones

Puedes usar varias funciones de agregacion en el mismo SELECT:

SELECT COUNT(*) AS total_productos, ROUND(AVG(precio), 2) AS precio_promedio, MIN(precio) AS mas_barato, MAX(precio) AS mas_caro, SUM(stock) AS stock_totalFROM productos;Esto te da un resumen completo de tu tabla de productos en una sola consulta.

GROUP BY: Agrupando filas

Las funciones de agregacion se vuelven realmente poderosas cuando las combinas con GROUP BY. En vez de un solo resumen para toda la tabla, obtienes un resumen por grupo.

-- Cuantos productos hay en cada categoria?SELECT categoria, COUNT(*) AS cantidadFROM productosGROUP BY categoria;El resultado seria algo como:

| categoria | cantidad |

|---|---|

| Electronica | 6 |

| Accesorios | 5 |

| Muebles | 4 |

Mas ejemplos:

-- Precio promedio por categoriaSELECT categoria, ROUND(AVG(precio), 2) AS precio_promedio, COUNT(*) AS cantidadFROM productosGROUP BY categoria;

-- Total de ventas por estado del pedidoSELECT estado, COUNT(*) AS cantidad_pedidos, SUM(total) AS suma_totales, ROUND(AVG(total), 2) AS promedio_totalFROM pedidosGROUP BY estado;

-- Cuantos clientes por ciudad?SELECT ciudad, COUNT(*) AS total_clientesFROM clientesGROUP BY ciudadORDER BY total_clientes DESC;Regla importante de GROUP BY

Cuando usas GROUP BY, todas las columnas en el SELECT deben ser: (a) columnas por las que agrupas, o (b) funciones de agregacion. No puedes poner una columna suelta que no este en el GROUP BY ni dentro de una funcion de agregacion.

Esto es un error comun:

-- ERROR: "nombre" no esta en GROUP BY ni es una funcion de agregacionSELECT nombre, categoria, COUNT(*)FROM productosGROUP BY categoria;PostgreSQL te va a dar un error porque nombre no sabe cual devolver: hay muchos nombres por categoria. Tienes que elegir: o lo agregas al GROUP BY, o usas una funcion de agregacion como MIN(nombre), MAX(nombre), etc.

GROUP BY con multiples columnas

Puedes agrupar por mas de una columna. Esto crea grupos mas granulares:

-- Cuantos pedidos por estado Y por mesSELECT estado, EXTRACT(MONTH FROM fecha) AS mes, COUNT(*) AS cantidad, SUM(total) AS total_ventasFROM pedidosGROUP BY estado, EXTRACT(MONTH FROM fecha)ORDER BY mes, estado;-- Salario promedio por departamentoSELECT departamento, COUNT(*) AS empleados, ROUND(AVG(salario), 2) AS salario_promedio, MIN(salario) AS salario_minimo, MAX(salario) AS salario_maximoFROM empleadosGROUP BY departamentoORDER BY salario_promedio DESC;HAVING: Filtrar grupos

Ya conoces WHERE para filtrar filas individuales. Pero WHERE se ejecuta antes de agrupar, asi que no puedes usarlo para filtrar basandote en el resultado de una funcion de agregacion.

Para eso existe HAVING: filtra grupos despues de la agregacion.

-- Categorias que tienen mas de 5 productosSELECT categoria, COUNT(*) AS cantidadFROM productosGROUP BY categoriaHAVING COUNT(*) > 5;-- Ciudades con al menos 3 clientesSELECT ciudad, COUNT(*) AS total_clientesFROM clientesGROUP BY ciudadHAVING COUNT(*) >= 3ORDER BY total_clientes DESC;-- Clientes que han gastado mas de 1000 en totalSELECT cliente_id, COUNT(*) AS num_pedidos, SUM(total) AS gasto_totalFROM pedidosGROUP BY cliente_idHAVING SUM(total) > 1000ORDER BY gasto_total DESC;WHERE vs HAVING

Esta es una duda muy comun. La diferencia es cuando se aplica cada filtro: